Ieri Google ha presentato Gemini 3.1 Flash-Lite, il modello più economico dell’intera famiglia Gemini 3. Prima ancora di parlare di capacità, bisogna partire dai due numeri che lo definiscono meglio: 363 token al secondo di velocità di output e un prezzo di $0,25 per milione di token in ingresso.

Quest’ultimo dato acquista tutto il suo peso se confrontato con Gemini 3.1 Pro, che parte da $2 per milione di token in ingresso e $18 per milione in uscita. In pratica, Flash-Lite costa un ottavo del Pro sull’input e dodici volte meno sull’output. Non è un modello progettato per eccellere su compiti di ragionamento complesso o generazione creativa sofisticata — è progettato per macinare volumi consistenti di lavoro nel minor tempo possibile, al costo più basso dell’intera serie.

Costruito a partire dall’architettura di Gemini 3 Pro — un sistema mixture-of-experts che attiva solo una parte dei propri parametri per ogni risposta — Flash-Lite eredita una base solida che viene ottimizzata per ridurre latenza e costo per token. Il risultato è un modello multimodale nativo in grado di elaborare testo, immagini, audio e video con una finestra di contesto fino a 1 milione di token e un output massimo di 64.000 token.

Velocità e costo come priorità: dov’è il confine tra forza e limite

Osservando i dati di valutazione pubblicati da Google DeepMind, Flash-Lite eccelle dove la velocità conta più della perfezione, e in alcune aree riesce a sorprendere anche sul piano qualitativo.

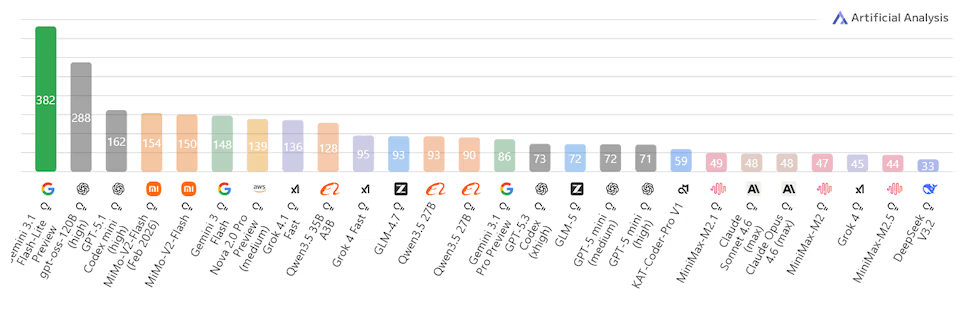

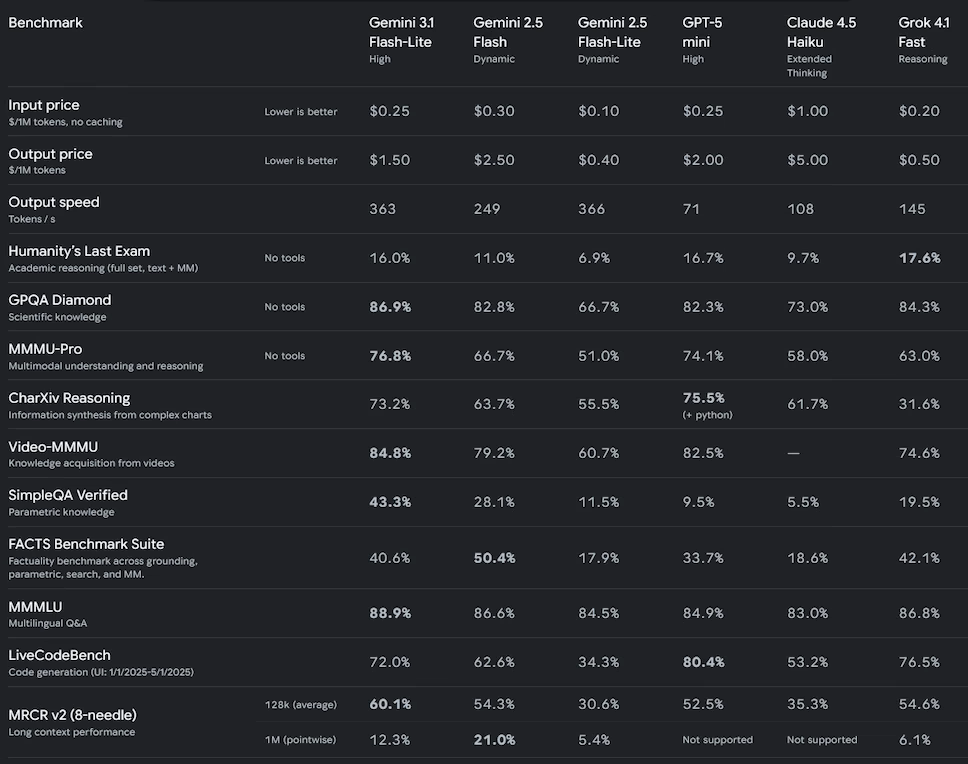

Sul benchmark GPQA Diamond — una suite di circa 200 domande a livello dottorale su fisica, chimica e biologia — ottiene 86,9%, superando sia GPT-5 mini (82,3%) che Claude 4.5 Haiku con Extended Thinking (73%). Sul fronte multimodale, segna 76,8% su MMMU-Pro, superiore a tutti i competitor della stessa fascia di prezzo. La velocità di output, misurata da Artificial Analysis, si attesta a 382 token al secondo, contro i 249 del precedente Gemini 2.5 Flash — un vantaggio difficile da ignorare in applicazioni dove la latenza ha un impatto diretto sull’esperienza finale.

Esistono tuttavia aree dove Flash-Lite cede chiaramente terreno. Sul FACTS Benchmark Suite, che valuta la fondatezza delle risposte su fonti grounded, parametriche e di ricerca, Gemini 2.5 Flash segna 50,4% contro il 40,6% di Flash-Lite. Sul LiveCodeBench, GPT-5 mini ottiene 80,4% contro il 72% di Flash-Lite. Non si tratta di lacune sistemiche, ma di trade-off attesi in un modello progettato per massimizzare efficienza e velocità.

Se stai invece gestendo migliaia o più richieste al giorno e latenza e costi hanno la priorità, la scelta si restringe principalmente tra Gemini 3.1 Flash-Lite e Grok 4.1 Fast. Il secondo è più economico ($0,20/$0,50 per milione di token), ma genera solo 145 token al secondo — poco più di un terzo della velocità di Flash-Lite. Se la velocità di risposta è il fattore critico, Flash-Lite non ha rivali diretti nella fascia.

Thinking level: ragionamento calibrato

Una delle novità architetturali più interessanti della serie 3.1 rispetto alla versione 2.5 è la funzionalità chiamata Thinking Level, che permette di regolare la profondità di elaborazione in base alla complessità del compito. Sono disponibili quattro livelli:

- Minimal e Low — Adatti a carichi ad alta frequenza e bassa latenza, tra cui classificazione, analisi di base e semplice estrazione dati. In queste modalità, ogni millisecondo risparmiato si traduce in costi scalabili inferiori.

- Medium e High — Attivano la logica Deep Think Mini per gestire istruzioni complesse, ragionamento multi-step e generazione di strutture dati articolate.

È in questa seconda modalità che Flash-Lite può costruire dashboard HTML/CSS o componenti React da prompt in linguaggio naturale, mantenere la coerenza logica in simulazioni a lungo contesto, o fungere da motore per la generazione di dataset sintetici.

Se stai sviluppando un’applicazione ad alto volume, vale la pena sperimentare la combinazione tra livello di thinking e tipo di task. Non tutti i flussi richiedono la stessa profondità di elaborazione, e calibrare questo parametro correttamente può fare la differenza tra un’architettura sostenibile e una che brucia il budget API in pochi giorni.

Gemini 3.1 Flash-Lite: dove provarlo subito

Google AI Studio (aistudio.google.com) è la via più rapida per chi vuole iniziare a provare Gemini 3.1 Flash-Lite. È disponibile anche tramite la Gemini API su Google AI Studio.

Il model ID da usare nelle chiamate API è gemini-3.1-flash-lite-preview. Vertex AI è invece il canale per ambienti enterprise.

OpenRouter ha già listato il modello come google/gemini-3.1-flash-lite-preview, con supporto completo ai Thinking Levels e un costo pari a circa la metà di Gemini 3 Flash Preview. Questo significa che è anche accessibile da tutti gli strumenti che si appoggiano a OpenRouter, tra cui Cline (via VSCode) e Kilo Code. Firebase AI Logic supporta anch’esso Flash-Lite per app mobile e web, accessibile tramite gli SDK Firebase per iOS, Android e web.

Google Antigravity — la piattaforma IDE di Google per il coding AI — è confermata per Gemini 3.1 Pro e Gemini 3 Flash, ma al momento non supporta nessun modello Flash-Lite.

Gemini 3.1 Flash-Lite: per lavori veloci e ad alto volume

Gemini 3.1 Flash-Lite non è un modello pensato per stupire nei benchmark. È pensato per funzionare a scala, in ambienti dove velocità e costo contano più della raffinatezza della risposta. Sul piano della sicurezza, il model card di Google DeepMind certifica che Flash-Lite ha superato le soglie richieste per il child safety e non ha mostrato problemi durante il red teaming manuale. Le perdite nelle valutazioni automatizzate di sicurezza sono state ricondotte principalmente a falsi positivi.

Chi invece ha bisogno del meglio possibile in coding, ragionamento multi-step, accuratezza fattuale o compiti delicati ad alta precisione, dovrebbe guardare ad altri modelli come Gemini 3.1 Pro, Claude Opus 4.6 o GPT 5.3. Non perché Flash-Lite sia scarso, ma perché è stato disegnato con un’altra gerarchia di priorità.